Har funne fordomsfulle algoritmar med makt

— Me ser at algoritmar faktisk kan vera fordomsfulle og diskriminera. Dei kan utøva makt, som er vanskeleg å oppdaga, seier Nicholas Diakopoulos og meiner algoritmane treng kritisk søkelys på seg.

OBS! Denne artikkelen er mer enn tre år gammel, og kan inneholde utdatert informasjon.

Algoritmar styrer meir og meir av kvardagen rundt oss. Føresteamanuensis Nicholas Diakopoulos meiner ein må retta meir kritisk søkelys på kva konsekvensar bruken kan få, skriv På Høyden.

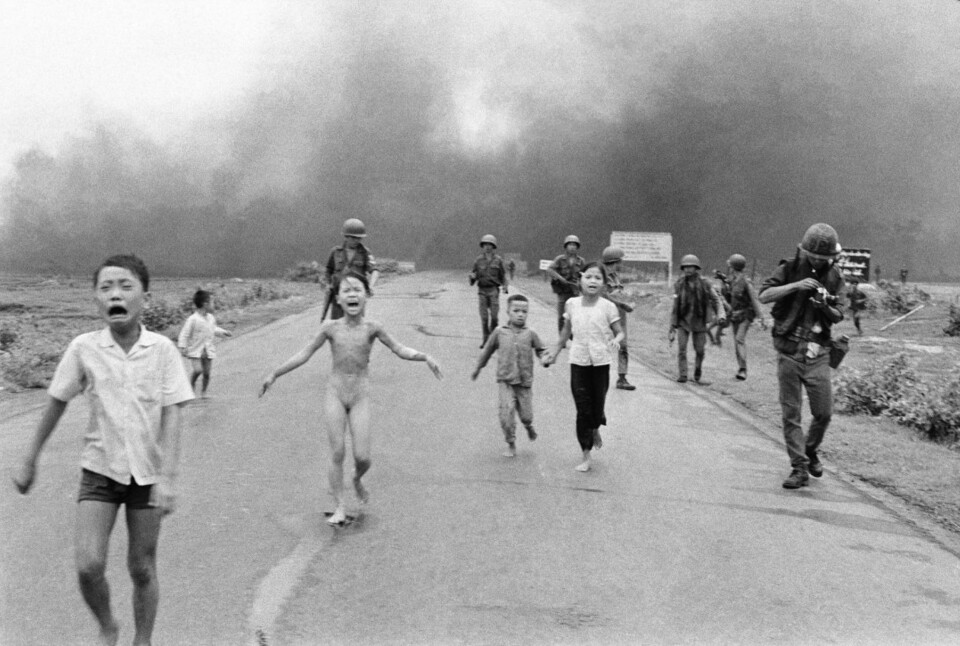

Dei siste vekene har det storma i norske medium etter at Facebook konsekvent har sletta alle postar av Nick Uts ikoniske bilde (under) av ei ung jente som flyktar frå napalmbombene under Vietnamkrigen.

Etter mykje press snudde Facebook og tillét bildet likevel. Algoritmar får skulda for «sensuren».

Men det er ikkje berre Facebook som brukar dei. I USA har algoritmane også funne vegen inn i rettssystemet.

Før studentar går ut av studiet bør dei skjønna korleis algoritmar styrer innhaldet i til dømes

sosiale medium.

Nicholas Diakopoulos

Fordomsfulle algoritmar

— Me ser at algoritmar faktisk kan vera fordomsfulle og diskriminera. Dei kan utøva makt, som er vanskeleg å oppdaga med det blotte auget, seier Diakopoulos.

Forutan jobben som førsteamanuensis ved Universitetet i Maryland, jobbar han med prosjektet VisMedia ved UiB – som tar for seg bruk av visuell overvakingsteknologi i media.

No er han i Bergen for å undervisa journaliststudentar i algoritmar si truverd, og korleis ein skal gå dei etter i saumane.

— Dette er viktig kunnskap for journalistar. Når algoritmane styrer så mykje rundt oss, er me avhengige av å retta eit kritisk søkelys mot dei. Korleis kan me elles ha eit informert demokrati? spør han.

Gjev kriminelle poengsum

Ifølge ei undersøking nettstaden Propublica har gjort, blir kriminielle i enkelte statar i USA gjevne ein data-generert poengsum som seier noko om kor sannsynleg det er at dei vil begå nye lovbrot i framtida.

Dette påverkar straffeutmåling og høve for kausjon. Å vera mørkhuda kunne gje negativt utslag.

— Dei prøver å måla risikoen ved å sleppa deg ut. Men det er vanskeleg å peika på kva vurdering som blir lagt til grunn. Propublica fann ut at rating-systemet kunne vera «fordomsfullt» mot ikkje-kvite.

Sjølv har han blant anna sett nærare på transport-tenesta Uber og korleis det verkar som om dei yter betre service i område kor det bur fleire kvite.

Uber rask for kvite

— Me fann ut at viss du bur i eit nabolag med større del av farga innbyggarar enn andre stader, må du rekna med å venta lenger på ein Uber-taxi, dette er basert på datasystemet deira, seier Diakopoulos.

Du kan lesa meir om undersøkinga som vart publisert i Washington Post her.

— Det er vanskeleg å tru at diskrimineringa skjer med viten og vilje. Men det er noko i algoritmane som gjer at fordelinga av bilar kjem skeivt ut. Ein må stilla spørsmål ved det.

Kan påverka om folk stemmer

Dei vel kva for bilde som slepp gjennom nålauga, men Google og Facebook kan også påverka folk politisk.

— Viss du søker på Hillary Clinton, sender søkemotoren dei i retning av saker som gjev negativ eller positiv publisitet om ho. Studiar viser at søkemotorar indirekte kan avgjerda kva folk ender opp med å stemma.

Hans eigne undersøkingar viser faktisk at Google føretrekk Demokratane og politikarar frå dette partiet.

Facebook kan på si side vera med på å avgjera om folk stemmer i det heile tatt.

— Di meir harde nyheiter du ser i feeden din i Facebook, di meir sannsynleg er det at du går og stemmer, ifølge forsking. Facebook har moglegheit til å skru opp og ned kva for type nyheiter som kjem opp i feeden.

Etterlyser openheit

Diakopoulos meiner myndigheitene og andre selskap burde vera meir opne om bruken av algoritmar.

— Me må få tilgang til korleis dette verkar. Særleg viss myndigheitene bruker algoritmar, som i rettsvesenet i USA, bør dei vera opne om det, og visa oss kva dei legg til grunn for utrekningane. Slik kan me ettergå informasjonen, og finna ut om det skjer urettar.

Han er svært opptatt av at journalistar må dykka djupare ned i materien. Gjerne i samarbeid med andre.

— Dei må gjerne jobba med dataingeniørar som har teknisk kunnskap til å grava seg ned i systema. Og ikkje minst må dei sjå på kven desse folka som lager systema er. Kva for bindingar har dei?

Eit viktig spørsmål er kvifor ein ser at algoritmane kan vera partiske.

— Det er vanskeleg å veta kvifor me ser dei mønstera som me ser. Kanskje får me fleire treff på Donald Trump i søkemotorane fordi han seier meir kontroversielle ting, eller fordi media dekker desse tinga meir. Det er det me må finna ut.

Blind tru på tala

— Eg trur dessverre det ofte blir tatt for gitt at taldata er objektiv og «sann informasjon», seier professor i medievitskap ved UiB, Astrid Gynnhild.

Ho trur nok norske journalistar har litt å gå på når det gjeld kunnskap om algoritmar, og kva dei kan føra med seg.

— Journalistar står alltid i fare for å bli manipulert av tal som dei ikkje kjenner opphavet til. Difor er det viktig for studentar å trena systematisk på kritisk vurdering av ulike typer taldata gjennom utdanninga. Før studentar går ut av studiet bør dei skjønna korleis algoritmar styrer innhaldet i til dømes sosiale medium.

Logg inn med en Google-konto, eller ved å opprette en Commento-konto gjennom å trykke på Login under. (Det kan være behov for å oppdatere siden når man logger inn første gang)

Vi modererer debatten i etterkant og alle innlegg må signeres med fullt navn. Se Khronos debattregler her. God debatt!